Souveräne KI Agenten: AI Agents mit verschiedenen LLMs selbst hosten

Souveräne KI Agenten sind der Schlüssel zur digitalen Unabhängigkeit europäischer Unternehmen. Während die Welt über ChatGPT und Claude spricht, entsteht im Hintergrund eine technologische Revolution: autonome AI Agents, die nicht an einen einzelnen Anbieter gebunden sind, verschiedene Large Language Models (LLMs) nutzen können – und sich vollständig in der eigenen Infrastruktur betreiben lassen. In diesem Beitrag beleuchten wir die wichtigsten Frameworks, ihre Einsatzgebiete und warum europäische Unternehmen jetzt auf souveräne KI-Lösungen setzen sollten. Wer zuerst die Grundlagen verstehen möchte, findet in unserem Beitrag Künstliche Intelligenz – einfach erklärt einen guten Einstieg.

Was sind souveräne KI Agenten – und warum sind sie mehr als Chatbots?

Ein AI Agent ist weit mehr als ein Chatbot, der Fragen beantwortet. Souveräne KI Agenten können eigenständig Aufgaben planen, Werkzeuge nutzen, Entscheidungen treffen und mehrstufige Workflows abarbeiten. Sie verbinden ein oder mehrere LLMs mit externen Datenquellen, APIs und Geschäftslogik. Während ein Chatbot auf eine einzelne Frage reagiert, kann ein Agent beispielsweise eine komplette Recherche durchführen, Ergebnisse zusammenfassen, eine E-Mail verfassen und diese zur Freigabe vorlegen – alles in einem Arbeitsschritt. Wie leistungsfähig KI-gestützte Suche bereits ist, zeigt unser Artikel über Perplexity als KI-Suchmaschine.

Das Besondere: Moderne Agent-Frameworks sind modellunabhängig. Sie können mit verschiedenen LLMs arbeiten – ob OpenAI GPT-4o, Anthropic Claude, Mistral, Llama von Meta oder das europäische Aleph Alpha. Diese Flexibilität ist entscheidend für Unternehmen, die sich nicht von einem einzelnen US-Anbieter abhängig machen wollen.

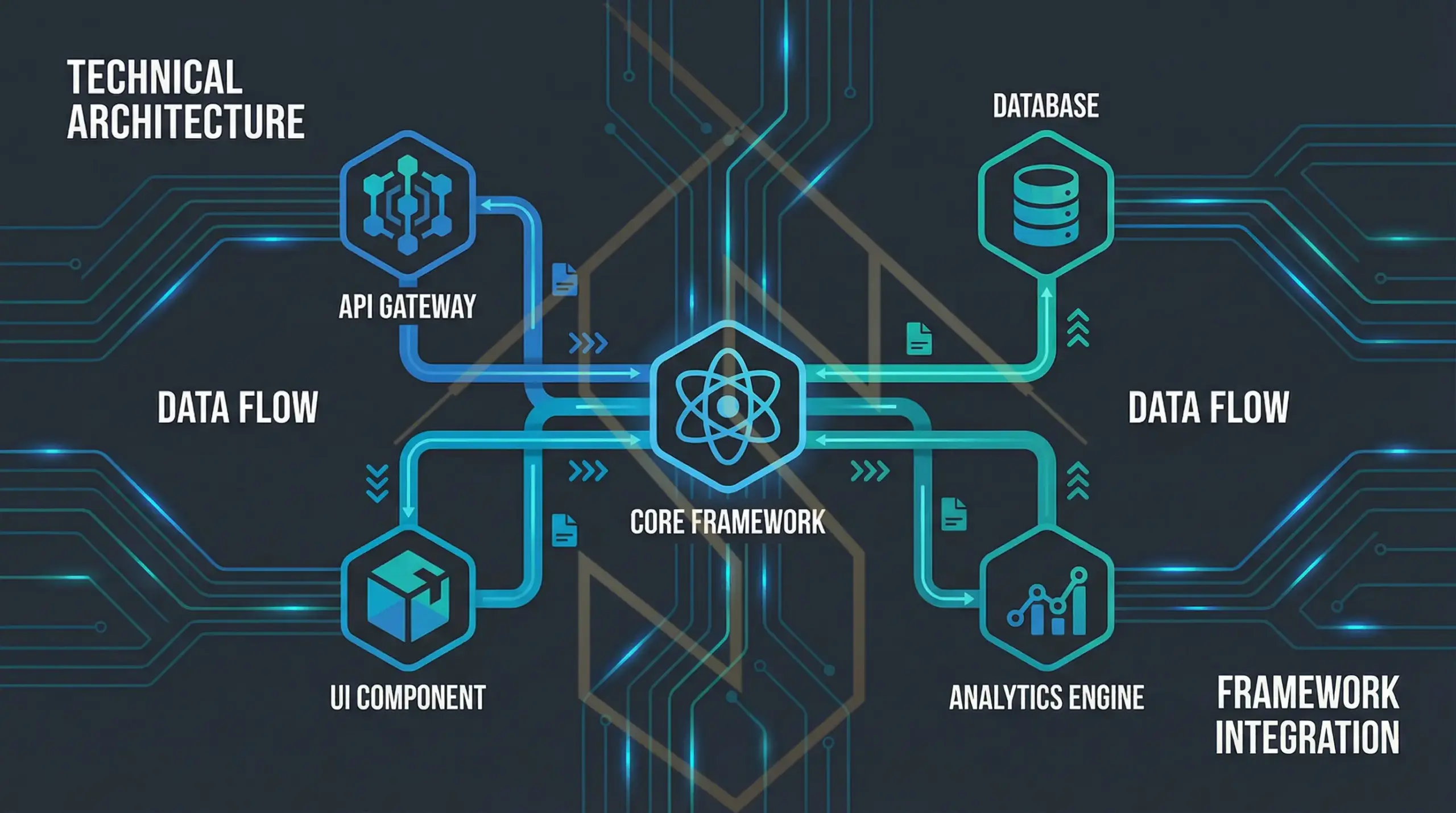

Die wichtigsten Agent-Frameworks im technischen Überblick

1. LangChain / LangGraph

LangChain ist das wohl bekannteste Framework für LLM-basierte Anwendungen. Mit LangGraph bietet es eine Erweiterung für zustandsbehaftete, mehrstufige Agent-Workflows. LangChain unterstützt praktisch jedes relevante LLM – von OpenAI über Anthropic bis hin zu lokal betriebenen Open-Source-Modellen via Ollama oder vLLM.

- Einsatzgebiet: Komplexe RAG-Pipelines (Retrieval-Augmented Generation), Dokumentenanalyse, automatisierte Recherche

- Selfhosting: Vollständig selbst hostbar, inklusive lokaler LLMs

- Sprache: Python, JavaScript/TypeScript

2. CrewAI

CrewAI setzt auf ein Team-Konzept: Mehrere spezialisierte KI Agenten arbeiten als „Crew“ zusammen und übernehmen jeweils definierte Rollen. Ein Agent recherchiert, ein anderer schreibt, ein dritter prüft die Ergebnisse. Dieses Prinzip der Arbeitsteilung führt zu deutlich besseren Ergebnissen als ein einzelner Agent.

- Einsatzgebiet: Content-Erstellung, Marktanalyse, automatisierte Reports, Qualitätssicherung

- Selfhosting: Open Source, läuft on-premise mit beliebigen LLMs

- Sprache: Python

3. AutoGen (Microsoft)

AutoGen von Microsoft Research ermöglicht Multi-Agent-Konversationen. Agenten kommunizieren untereinander, delegieren Aufgaben und lösen Probleme kollaborativ. Besonders stark ist AutoGen bei der Code-Generierung und -Ausführung.

- Einsatzgebiet: Software-Entwicklung, Datenanalyse, wissenschaftliche Forschung

- Selfhosting: Open Source, unterstützt lokale Modelle

- Sprache: Python

4. Haystack (deepset – Made in Germany)

Besonders relevant für souveräne KI Agenten in Europa: Haystack von deepset, einem Berliner Unternehmen. Haystack ist ein produktionsreifes Framework für LLM-Anwendungen mit starkem Fokus auf Dokumentenverarbeitung und Suchsysteme. Die enge Zusammenarbeit mit europäischen Unternehmen und die DSGVO-konforme Architektur machen es zur ersten Wahl für datensensible Branchen.

- Einsatzgebiet: Enterprise Search, Wissensmanagement, Kundensupport, Compliance-Dokumentation

- Selfhosting: Vollständig on-premise, speziell für europäische Anforderungen entwickelt

- Sprache: Python

5. n8n mit AI-Agent-Nodes

Für Unternehmen, die No-Code/Low-Code bevorzugen, bietet n8n (ebenfalls ein europäisches Produkt aus Berlin) eine mächtige Plattform. Mit den integrierten AI-Agent-Nodes lassen sich LLM-gestützte Workflows visuell zusammenbauen – inklusive Tool-Nutzung, Speicher und Entscheidungslogik.

- Einsatzgebiet: Workflow-Automatisierung, CRM-Integration, E-Mail-Verarbeitung, Ticketing

- Selfhosting: Self-hosted Community Edition kostenlos verfügbar

- Sprache: Visueller Editor, TypeScript

Warum souveräne KI Agenten für Europa entscheidend sind

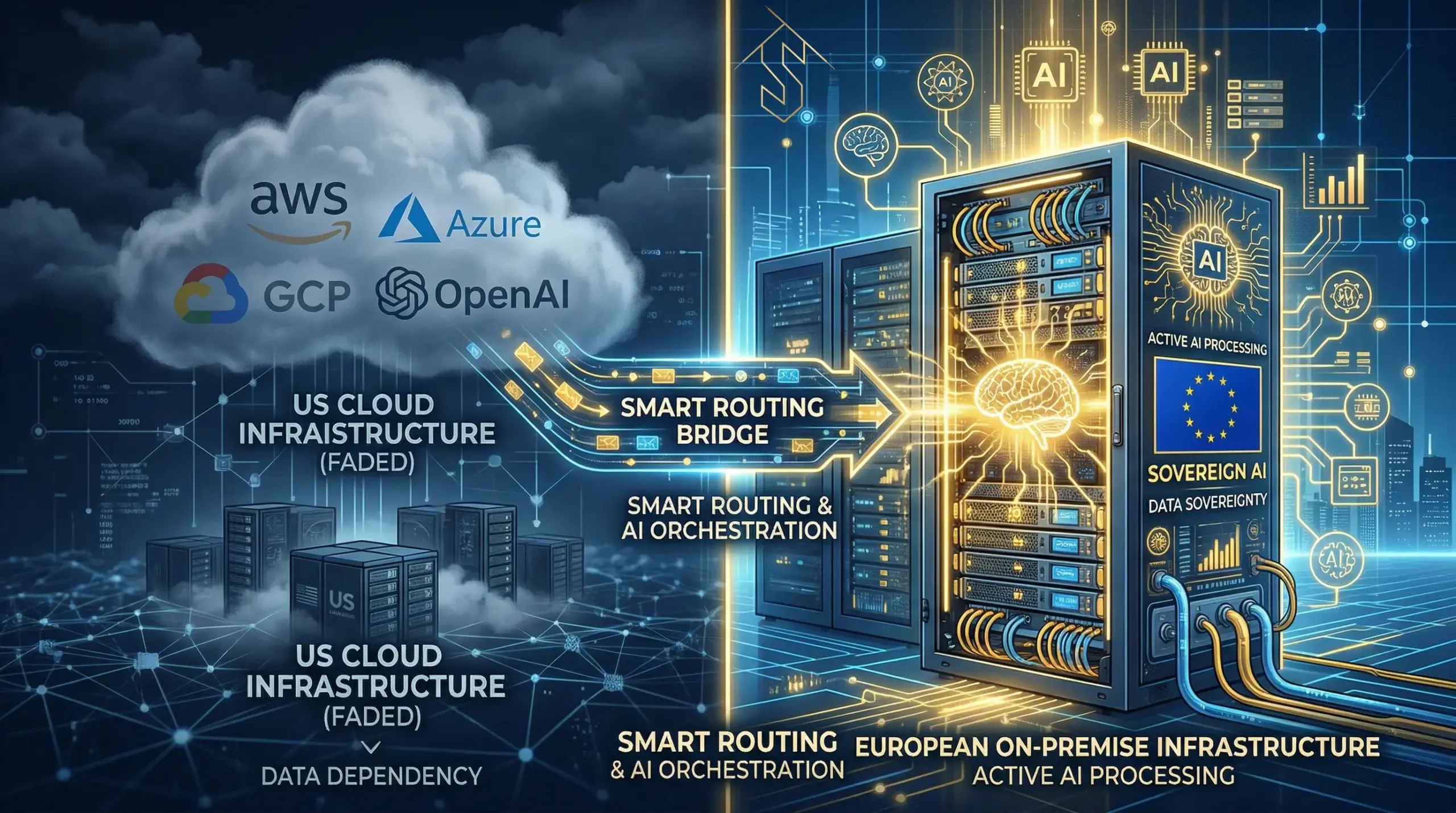

Die Abhängigkeit von US-amerikanischen Cloud-Diensten für KI-Anwendungen birgt reale Risiken: Datenschutzbedenken durch den US CLOUD Act, unkontrollierbare Preiserhöhungen, Vendor Lock-in und fehlende Transparenz bei der Datenverarbeitung. Wie konkret solche Risiken aussehen können, zeigt unsere Analyse eines Sicherheitsvorfalls in der Microsoft-Cloud-Infrastruktur. Souveräne KI Agenten lösen diese Probleme an der Wurzel.

Datensouveränität: Wenn LLMs lokal betrieben werden – etwa mit Llama 3, Mistral oder dem deutschen Luminous von Aleph Alpha – verlassen sensible Unternehmensdaten niemals die eigene Infrastruktur. Kundendaten, Verträge, interne Dokumente bleiben dort, wo sie hingehören. Ein ergänzendes Sicherheitskonzept wie Zero Trust stärkt den Schutz zusätzlich.

DSGVO-Konformität: Selfhosting auf europäischen Servern garantiert die Einhaltung der DSGVO. Es gibt keinen Datenfluss in Drittstaaten und keine komplexen Auftragsverarbeitungsverträge mit US-Anbietern. Auch die europäische KI-Verordnung (AI Act) lässt sich mit selbst gehosteten Systemen deutlich einfacher einhalten.

Kosteneffizienz: Nach der Anfangsinvestition in Hardware (oder europäische Cloud-Infrastruktur wie Exoscale, Hetzner, IONOS oder OVHcloud) fallen keine laufenden API-Kosten pro Token an. Bei hohem Nutzungsvolumen amortisiert sich Selfhosting schnell. Wie sich Cloud-Kosten gezielt optimieren lassen, zeigt unsere FinOps-Beratung fuer Azure, Exoscale und Hetzner. Grundlagen zur Serverinfrastruktur vermittelt unser Beitrag über die Welt der Virtualisierung.

Anpassbarkeit: Lokale Modelle können mit eigenen Daten feinabgestimmt (Fine-Tuning) werden. Ein KI Agent, der auf unternehmensspezifischem Wissen trainiert wurde, liefert drastisch bessere Ergebnisse als ein generisches Cloud-Modell.

Praxisbeispiel: Souveräne KI Agenten im Unternehmenseinsatz

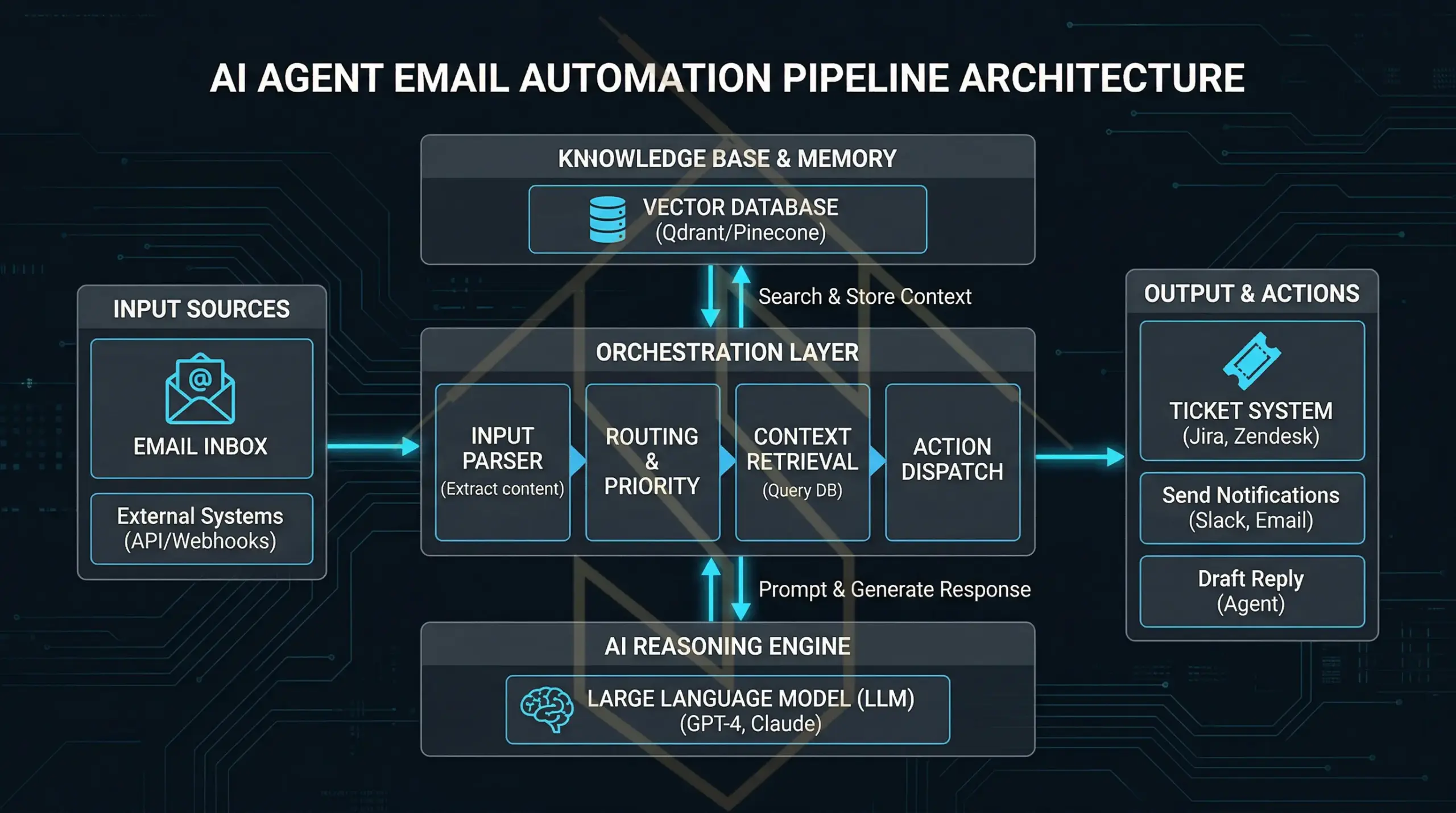

Ein konkretes Szenario: Ein mittelständisches Unternehmen möchte eingehende Kundenanfragen automatisch klassifizieren, relevante Informationen aus der internen Wissensdatenbank abrufen und Antwortvorschläge generieren.

Die Architektur könnte so aussehen:

- Agent-Framework: LangGraph oder Haystack als Orchestrierungsschicht

- LLM: Mistral Large oder Llama 3 70B, lokal via vLLM oder Ollama

- Vektordatenbank: Qdrant oder Milvus (beide Open Source) für die Wissensdatenbank – zur professionellen Datenbankbetreuung bieten wir auch Postgres Datenbankadministration

- Integration: n8n verbindet E-Mail-Postfach, Ticketsystem und Agent-Pipeline

- Hosting: Europäischer Server bei Hetzner oder in der eigenen Serverinfrastruktur

Das Ergebnis: Ein vollständig souveränes System, das rund um die Uhr arbeitet, keine Daten nach aussen sendet und sich flexibel an neue Anforderungen anpassen lässt. Die Kosten? Ein Bruchteil dessen, was vergleichbare SaaS-Lösungen auf Dauer kosten würden.

Open-Source-LLMs: Die Basis für souveräne KI Agenten

Die Qualität von Open-Source-Modellen hat 2025 ein Niveau erreicht, das sie für viele Anwendungen gleichwertig mit proprietären Modellen macht. Besonders hervorzuheben sind:

- Mistral Large / Mixtral: Französisches Unternehmen, europäische Werte, hervorragende Performance bei Reasoning und Code

- Llama 3 (Meta): Eines der leistungsstärksten Open-Source-Modelle, frei verfügbar für kommerzielle Nutzung

- Aleph Alpha Luminous: Made in Germany, speziell für europäische Compliance-Anforderungen konzipiert

- DeepSeek: Starke Performance bei technischen und analytischen Aufgaben

Mit Tools wie Ollama oder vLLM lassen sich diese Modelle mit wenigen Befehlen auf eigener Hardware starten. Eine aktuelle GPU mit 24 GB VRAM reicht für viele Modelle bereits aus – für grössere Modelle bieten sich Multi-GPU-Setups oder quantisierte Varianten an. Dass souveräne europäische Software-Alternativen zunehmend an Bedeutung gewinnen, zeigt auch das Projekt Euro-Office als europäische Microsoft-365-Alternative.

Der hybride Ansatz: Das Beste aus beiden Welten

In der Praxis muss es nicht „entweder Cloud oder Selfhosting“ heissen. Ein hybrider Ansatz erlaubt es, für unkritische Aufgaben leistungsstarke Cloud-Modelle (Claude, GPT-4o) zu nutzen und für sensible Daten auf lokale Modelle auszuweichen. Agent-Frameworks wie LangChain machen dieses Routing elegant möglich – der KI Agent entscheidet basierend auf der Datensensibilität, welches Modell zum Einsatz kommt.

Dieser Ansatz vereint maximale Leistung mit maximaler Souveränität und ist besonders für den Einstieg in die Welt der souveränen KI Agenten ideal. Welche weiteren Technologie-Trends Unternehmen aus unserer Vorhersage 2025 im Blick haben sollten, lesen Sie in unserem Beitrag zu den Top 10 bahnbrechenden Technologien für 2025.

Fazit: Jetzt handeln und KI-Souveränität sichern

Souveräne KI Agenten sind keine Zukunftsmusik – sie sind heute einsatzbereit. Die Kombination aus ausgereiften Agent-Frameworks, leistungsstarken Open-Source-LLMs und europäischer Hosting-Infrastruktur macht es möglich, KI-Lösungen aufzubauen, die höchsten Datenschutzstandards genügen und gleichzeitig echten Geschäftswert liefern.

Die Frage ist nicht mehr ob, sondern wann Ihr Unternehmen auf souveräne KI Agenten setzt. Wer jetzt startet, sichert sich einen entscheidenden Wettbewerbsvorteil – und behält die Kontrolle über seine Daten und Prozesse.

Sie möchten souveräne KI Agenten in Ihrem Unternehmen einsetzen? Die SKAWINSKI GmbH berät Sie von der Strategieentwicklung über die Architektur bis zum produktiven Betrieb – herstellerunabhängig, DSGVO-konform und mit Fokus auf europäische Lösungen.

Kontakt

SKAWINSKI GmbH

- E-Mail: o@skawinski.at

- Telefon: +43 660 / 50 924 94

- Website: www.skawinski.at